Anthropic lanza Claude Opus 4.6: El Fin de la Amnesia Artificial y el Salto Cuántico en Retención Contextual

En el vertiginoso panorama de la inteligencia artificial generativa, un tema que analizamos frecuentemente en nuestra sección de noticias de IA es la métrica del tamaño: cuántos parámetros tiene el modelo y, más recientemente, cuánta información puede «leer» de una sola vez. Sin embargo, el escenario ha cambiado drásticamente ahora que Anthropic lanza Claude Opus 4.6. Ya no se trata solo del tamaño de la ventana de contexto, sino de la fidelidad con la que se procesa esa información.

Con una capacidad teórica de 1 millón de tokens, el nuevo modelo insignia no solo compite en volumen, sino que aborda el talón de Aquiles de los Grandes Modelos de Lenguaje (LLM): el «deterioro de contexto» (context rot). Tal como se detalla en la fuente oficial, Opus 4.6 ha logrado triplicar la capacidad efectiva de atención respecto a sus predecesores, marcando la diferencia entre una IA que simplemente ingiere datos y una que verdaderamente los comprende.

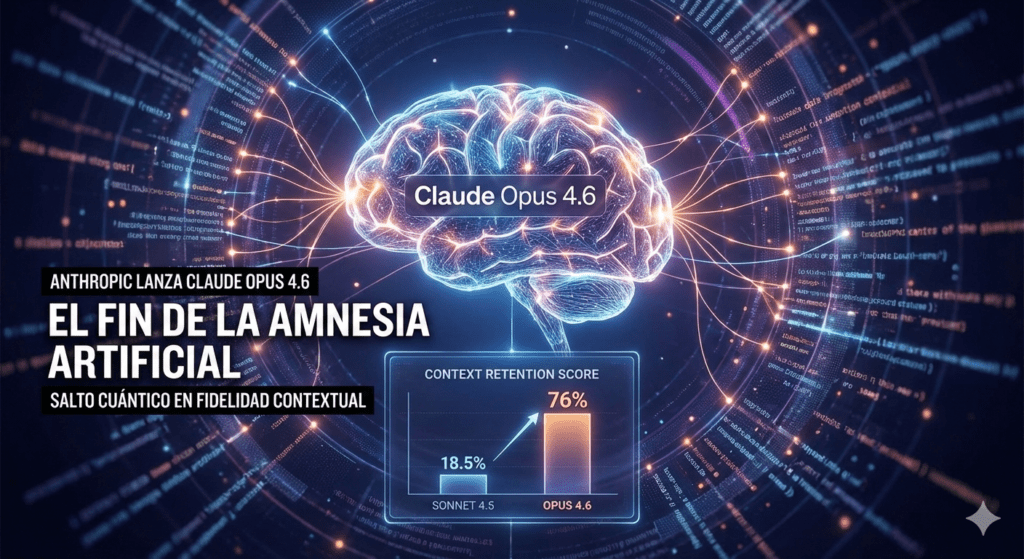

Del Volumen a la Fidelidad: El Salto del 18.5% al 76%

Para comprender la magnitud de este lanzamiento, es necesario analizar las limitaciones técnicas que han frustrado a desarrolladores y empresas en el último año. Hasta hace poco, modelos como Claude Sonnet 4.5 eran extremadamente capaces en tareas cortas, pero sufrían una caída dramática en rendimiento al enfrentarse a volúmenes masivos de datos.

En la prueba MRCR v2 (Multiple Retrieval Context Retrieval), considerada el estándar de oro para medir la «memoria» de una IA, Sonnet 4.5 obtenía apenas un 18.5% de precisión al buscar «agujas» de información específicas escondidas en un contexto de 1 millón de tokens. En términos prácticos, esto significaba que el modelo «olvidaba» o alucinaba sobre el 80% de los detalles críticos cuando se le saturaba de información.

Cuando Anthropic lanza Claude Opus 4.6, destroza ese techo técnico alcanzando una puntuación del 76% en la misma prueba.

Arquitectura de «Thinking Adaptativo» y Compactación

Este avance no es magia, sino ingeniería. Según los reportes técnicos, se han implementado dos novedades fundamentales:

- Thinking Adaptativo: Una reestructuración de cómo el modelo asigna recursos de cómputo a diferentes partes del contexto, priorizando la coherencia lógica sobre la generación lineal simple.

- Context Compaction (Compactación de Contexto): Una nueva funcionalidad en fase beta para la API. Esta herramienta permite que el modelo resuma y consolide automáticamente la información más antigua dentro de la ventana de contexto antes de que se pierda. Esto soluciona el problema de la «memoria de pez» en interacciones largas, permitiendo flujos de trabajo teóricamente infinitos sin la degradación severa que sufrían modelos anteriores.

Adicionalmente, se ha duplicado la capacidad de salida (output) de 64.000 a 128.000 tokens. Esto permite que el modelo no solo lea un libro entero, sino que pueda escribir una secuela, generar una base de código completa o redactar un borrador legal exhaustivo en una sola respuesta.

El Panorama Competitivo: La Guerra contra el «Context Rot»

El mercado actual se encuentra en un punto de inflexión. Durante los últimos años, competidores como Google y OpenAI han ofrecido ventanas de contexto masivas. Sin embargo, la industria acuñó el término «Context Rot» (podredumbre de contexto) para describir la frustrante experiencia de usuario donde los modelos, a pesar de aceptar millones de tokens, ignoraban instrucciones situadas en la mitad del documento o alucinaban conexiones inexistentes.

Comparativa de Rendimiento Actual

Los datos preliminares sitúan a Opus 4.6 en una posición de liderazgo clara en tareas de alta carga cognitiva:

- Claude Opus 4.6: Domina con un 76% en recuperación de contexto profundo y lidera los rankings de programación (Terminal-Bench 2.0).

- GPT-5.2 (OpenAI): Se mantiene como un competidor formidable con un ~68% en recuperación, aunque sigue dependiendo en gran medida de técnicas de RAG (búsqueda externa) para mantener la coherencia en documentos largos.

- Modelos Anteriores (Sonnet 4.5): Quedan relegados a tareas de respuesta rápida y baja latencia, dado su bajo rendimiento (18.5%) en análisis profundo.

Este lanzamiento representa un cambio de paradigma: intenta demostrar que el «cerebro» del modelo (su ventana de contexto activa) es superior a usar un «buscador» externo para sintetizar información compleja.

Impacto en la Industria y Casos de Uso Reales

La capacidad de retener y procesar con precisión un millón de tokens (aproximadamente 750.000 palabras o varias novelas completas) sin perder el hilo conductor transforma radicalmente varios sectores profesionales.

1. El Fin del «Chunking» en Legal y Ciencia

Hasta la llegada de este modelo, los analistas debían dividir los documentos grandes en fragmentos (chunking), pidiendo a la IA que resumiera por partes. Este proceso rompía las conexiones lógicas sutiles que pueden existir entre la página 10 y la página 800 de un sumario legal.

Con una tasa de éxito del 76%, un bufete de abogados puede cargar el historial completo de un litigio de varios años y realizar consultas complejas como: «Identifica las contradicciones cronológicas entre el testimonio del testigo X en 2023 y la prueba pericial Y presentada en 2025». La IA ahora tiene la capacidad de «ver» todo el panorama simultáneamente, reduciendo semanas de revisión humana a minutos de procesamiento.

2. La Era de la Programación «Agéntica»

La integración de Opus 4.6 en plataformas de desarrollo como Microsoft Foundry y su estatus como SOTA (State of the Art) en Terminal-Bench 2.0 indican que este modelo no es un simple asistente de chat, sino un agente activo.

Los desarrolladores pueden entregar al modelo un repositorio de código completo. Gracias a su memoria superior, Opus 4.6 puede refactorizar arquitecturas enteras recordando las dependencias definidas al inicio del proyecto, lo que reduce drásticamente los bugs introducidos por la IA, un problema endémico en la generación de código de 2025.

3. Confianza Corporativa y Alineación

Un detalle crucial en el informe técnico es la reducción de los «falsos rechazos». Históricamente, los modelos de seguridad de Anthropic eran conocidos por ser excesivamente cautelosos, negándose a procesar documentos legales o médicos inofensivos por «seguridad». Opus 4.6 parece haber calibrado este equilibrio, ofreciendo una herramienta robusta que entiende el matiz profesional sin censura innecesaria, lo que facilita su adopción en entornos corporativos regulados.

De Chatbot a Analista de Memoria Profunda

El titular técnico del «76% en pruebas de contexto» esconde una realidad operativa mucho más profunda: la inteligencia artificial ha triplicado su capacidad de atención efectiva.

El hecho de que Anthropic lanza Claude Opus 4.6 marca el momento en que los LLMs dejan de ser herramientas conversacionales con memoria a corto plazo para convertirse en analistas de memoria profunda. Mientras que la serie Sonnet sigue siendo ideal para la velocidad, Opus se establece como la única opción viable para tareas donde la síntesis, la coherencia y la retención de detalles a gran escala son no negociables. En la batalla por la inteligencia artificial útil, Anthropic ha demostrado que no basta con leer mucho; hay que entenderlo todo.