La publicación en Italia, el 27 de marzo de 2026, de la obra «Nutrire la macchina» (Alimentar la máquina) de James Muldoon, Mark Graham y Callum Cant, marca un hito en la desmitificación de la tecnología moderna. Esta investigación, traducida por el colectivo Ippolita y publicada por la editorial Mimesis, desmantela la narrativa de Silicon Valley que presenta a la IA como una entidad limpia y autónoma.

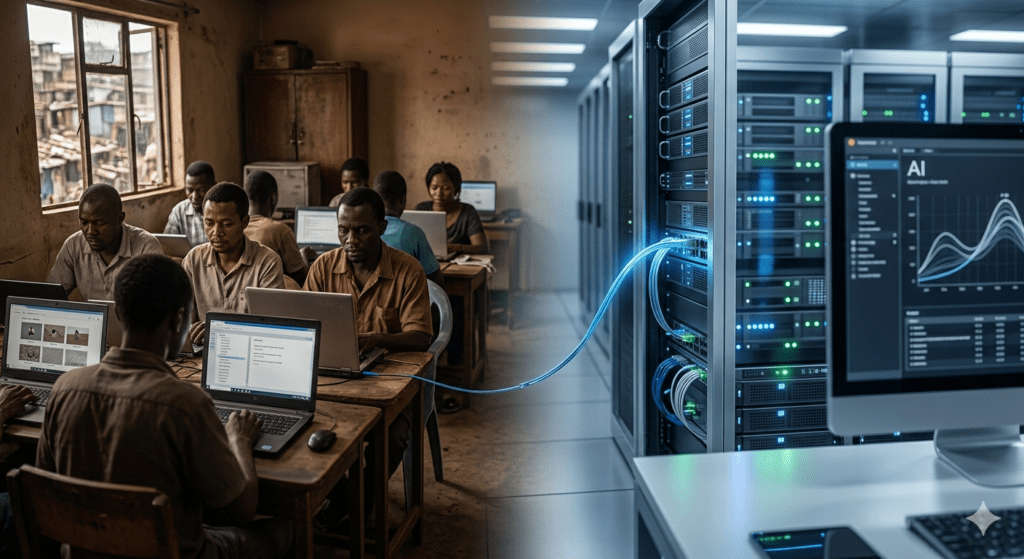

En realidad, el funcionamiento de modelos de lenguaje extenso (LLM) como ChatGPT depende de una infraestructura global de «trabajadores fantasma»: millones de personas en el Sur Global que realizan tareas extenuantes para que las máquinas parezcan inteligentes. Para mantenerte al día sobre este y otros temas de actualidad tecnológica, puedes consultar nuestra sección de noticias.

La Anatomía del Trabajo Invisible: El Motor tras el Algoritmo

La inteligencia artificial generativa no aprende en un vacío digital. Su entrenamiento requiere vastos conjuntos de datos refinados por seres humanos mediante el Aprendizaje Reforzado a partir de la Retroalimentación Humana (RLHF). Este proceso permite a sistemas como ChatGPT distinguir entre respuestas útiles y tóxicas.

El Ciclo de Preparación de Datos

Para que un modelo sea funcional, los datos brutos deben ser estructurados en varias etapas críticas:

| Etapa del Proceso | Tarea Humana Específica | Impacto en el Modelo de IA |

| Etiquetado | Asignación de categorías a imágenes o textos. | Reconocimiento de patrones. |

| Limpieza | Eliminación de errores y «ruido». | Evita resultados incoherentes. |

| Moderación | Identificación de material violento o de odio. | Filtra salidas tóxicas. |

| Evaluación (RLHF) | Calificación de respuestas según tono humano. | Refina la interacción «natural». |

Este trabajo es realizado por una fuerza laboral que opera a través de plataformas como Remotasks o empresas de subcontratación como Sama y Appen, a menudo sin conocer la identidad del cliente corporativo.

Geografías de la Explotación: De Nairobi a Manila

La cadena de suministro de la IA sigue rutas que replican antiguas estructuras coloniales, buscando jurisdicciones con bajos costos y regulaciones laxas.

Kenia y el Trauma de OpenAI

Una investigación de la revista TIME reveló que OpenAI utilizó a la empresa Sama en Nairobi para filtrar contenido tóxico. Los trabajadores fueron expuestos a descripciones gráficas de abuso sexual infantil, tortura y asesinato. Mientras OpenAI recibía inversiones multimillonarias, los salarios base eran de aproximadamente 170 dólares al mes.

La disparidad es alarmante: OpenAI pagaba a Sama entre 6.37 y 9.50 dólares por hora, pero el trabajador recibía entre 1.32 y 2 dólares. Matemáticamente, la relación de extracción se define como:

$$\text{Relación de Extracción} = \frac{\text{Tarifa Pagada por la Empresa Principal}}{\text{Salario Neto del Trabajador}}$$

En este caso, la cadena de suministro capturaba casi diez veces el valor que recibía el trabajador.

Filipinas y las «Maquilas Digitales»

En Filipinas, más de 2 millones de personas realizan «crowdwork». La plataforma Remotasks, de Scale AI, ha sido acusada de operar «maquilas digitales» donde los trabajadores perciben salarios por debajo del mínimo legal y sufren retrasos constantes en los pagos.

El Impacto Psicológico: El Trauma como Materia Prima

El costo de «limpiar» la IA es profundamente fisiológico. Los moderadores actúan como el primer frente de defensa contra lo peor de internet, lo que deriva en consecuencias clínicas graves:

- Visiones Recurrentes y Flashbacks: Revivir escenas de violencia en la vida cotidiana.

- Aislamiento Social: Alteración de la percepción social debido al contenido procesado.

- Trastorno de Estrés Postraumático (PTSD): Diagnosticado en una proporción significativa de trabajadores en África.

«Nutrire la macchina»: El Régimen de Atrapamiento

El libro de Muldoon, Graham y Cant propone el concepto de Régimen de Atrapamiento, donde los mecanismos de control impiden la movilidad del trabajador:

- Contratos Precarios: Uso de la figura de «freelancer» para eliminar beneficios sociales.

- Arbitraje Laboral Global: Desplazamiento del trabajo a regiones en crisis (como Venezuela o Madagascar).

- Vigilancia Algorítmica: Monitoreo deshumanizado del tiempo de respuesta.

Resistencia y el Laberinto Regulatorio

Frente a esto, ha surgido resistencia. En Kenia, se formó el primer sindicato de moderadores de África, iniciando litigios contra Meta y Sama por violaciones de derechos humanos. Aunque la justicia keniana determinó que tiene jurisdicción para juzgar a Meta, a marzo de 2026, los fallos han sido pospuestos y la mediación ha colapsado.

Por otro lado, el Acta de Inteligencia Artificial de la Unión Europea intenta regular el sector exigiendo gobernanza de datos y supervisión humana. Sin embargo, la Confederación Europea de Sindicatos advierte que el Acta carece de protecciones específicas para los trabajadores del Sur Global. Para profundizar en los detalles técnicos de esta regulación, puede consultar el sitio oficial del Artificial Intelligence Act.

Ética Corporativa vs. Realidad

Existe una brecha crítica entre la retórica de «IA para el bien» y la práctica:

- Appen: Declara transparencia, pero se le señala por usar trabajadores en campos de refugiados para tareas militares sin consentimiento.

- Scale AI: Declara cero tolerancia al abuso, pero se documentan pagos de 1 centavo por tarea.

Hacia una IA Sostenible

La verdadera «inteligencia» de sistemas como ChatGPT no reside en el silicio, sino en los millones de juicios humanos que filtran la oscuridad de la red. Sin una protección legal robusta y un salario digno, la IA seguirá siendo una tecnología alimentada por la precariedad y el olvido. La publicación de Nutrire la macchina es un recordatorio de que es imperativo desmantelar el régimen de ocultamiento que permite a las Big Tech beneficiarse del trauma ajeno.